Sie wollen mehr?

Mehr wissen, mehr erreichen, mehr verwirklichen?

Welche Möglichkeiten der Produktion und Visualisierung von Musik bieten Virtual Reality (VR)- Umgebungen? Dieser Frage nach dem Potenzial von interaktiven digitalen Welten ging das Kooperationsprojekt „Musik in interaktiven digitalen Welten: Entwicklung technischer und ästhetischer Methoden für Musikproduktion im digitalen Medium“ nach. Mithilfe von Calls for Transfer schlossen sich Expert:innen des Fachbereichs Multimediale Komposition der Hochschule für Musik und Theater und der Fakultät Design, Medien und Informatik der HAW Hamburg zusammen, um neue Möglichkeiten visualisierter Musik auszuloten und in einer ersten Fallstudie zu erforschen. Im Fokus der Untersuchungen stand dabei eine interaktive Musik– „Experience“ – also u.a. die Interaktion zwischen Publikum und dreidimensionalem Spielraum. Mithilfe unterschiedlicher Technologien wie Eye-Tracking und haptischem Feedback wurde der immersive Wirkungsgrad für Benutzer:innen untersucht – sprich: Wie tief zieht diese Experience die Teilnehmenden in die Welt visualisierter Musik?

Die Studie, die sich innerhalb der Forschungsschwerpunkte Audio-Design, Klangforschung, Game Design und User Experience bewegt, stellt neben der Frage der Interaktion auch die nach der Visualisierung von Musik. Sowohl visueller als auch klangbasierter Kunst bietet VR neue Darstellungsmöglichkeiten – gerade auch in der Vernetzung mit Ansätzen des Game Designs. Das Forschungsprojekt zwischen HfMT und der HAW Hamburg bietet daher eine Ausgangsbasis, die zur Einrichtung und Verstärkung interdisziplinärer Zusammenarbeit von Studierenden und Lehrenden in den Bereichen Audio-Spatialisierung, Synästhesie, Game Design, Immersion, Haptik und Musik dienen kann.

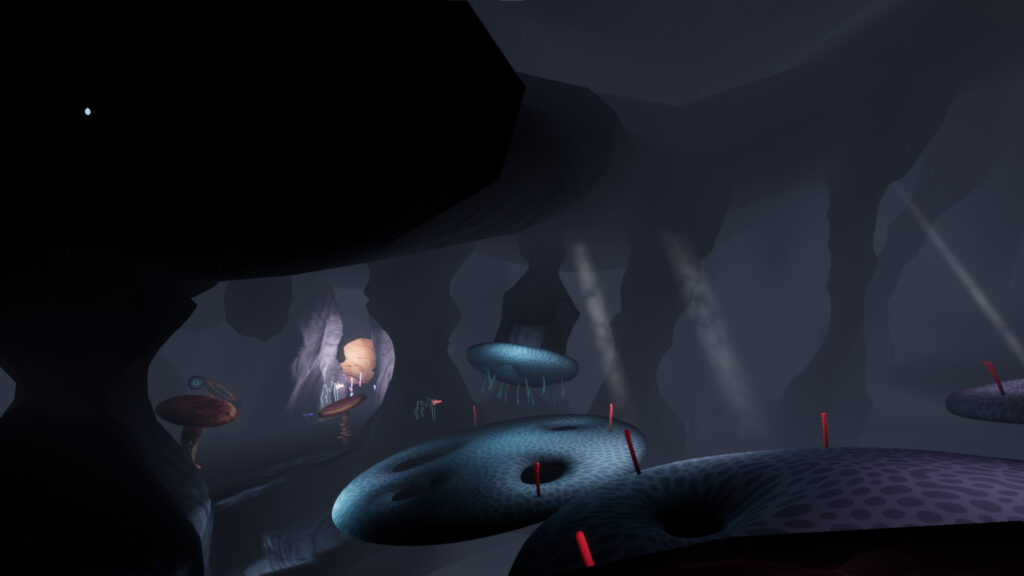

Unter der Leitung von Dr. Konstantina Orlandatou (HfMT), Professor Thomas Görne (HAW Hamburg) und Maik Helfrich (HAW Hamburg) wurde im Rahmen der C4T-Förderung die VR-Umgebung „Endogeny“ entwickelt. Diese VR-Umgebung ermöglicht den Spielenden eine musikalische Teilhabe und die Interaktion mit der digital erschaffenen Welt durch Greifen, Schlagen, Platzieren, Skalieren und das Bewegen von Objekten. Auf diese Weise können die Spielenden die VR-Umgebung selbständig durch visuelle und akustische Hinweise erkunden. Je nach physikalischer Eigenschaft des Objekts entstehen unterschiedliche Klänge, je nachdem ob nach dem Objekt gegriffen oder ob es platziert wird: Die Komposition von Musik in der VR-Umgebung vollzieht sich also durch die Interaktionen der Spielenden mit den Objekten. In „Endogeny“ soll die VR-Umgebung neben Spielraum also auch Aufführungsraum für Musik und Klang durch die aktive Auseinandersetzung der Spielenden mit den Objekten sein.

Die Ergebnisse der Forschungskooperation wurden sowohl im Rahmen des HAW Hamburg Rundgangs 2021, als auch im Rahmen der Videopräsentation „Display“ des GamesLab der HAW Hamburg präsentiert: https://youtu.be/km0Z7sOUB_s?t=711.

Neben einer wissenschaftlichen Studie (2021) zu User Interaction, Audio-Implementation und generellem Design wurde im Jahr 2022 eine Masterarbeit in Bezug auf das Projekt eingereicht. Mithilfe der C4T- Förderung konnte das Kooperationsprojekt somit eine Fallstudie entwickeln, die als Vorbereitung umfangreicher künstlerisch-technischer Forschungsprojekte dient. Diese umfassen die Ausarbeitung der bereits implementierten Features sowie der narrativen Struktur und loten weitere Interaktionsmöglichkeiten aus.